Надежна ли виртуальная ИТ-инфраструктура?

Виртуализация – общепризнанный тренд не только во всем мире, но и в России. Никто уже не спорит, что применение этих технологий удобно и выгодно. Однако возникает вопрос, насколько виртуальная ИТ-инфраструктура надежна по сравнению с физической.Сегодня многие крупные российские компании уже применяют технологии виртуализации в рамках большей части ИТ-инфраструктуры. При этом выбор данной технологии обоснован не только ее экономической эффективностью по сравнению с традиционным способом эксплуатации серверов, но и существенным повышением уровня непрерывности функционирования систем.

На первый взгляд консолидация нескольких виртуальных систем на одном физическом сервере существенно повышает риск выхода из строя целой группы сервисов в случае отказов оборудования. Но технология виртуализации, помимо возможностей консолидации, дает еще несколько преимуществ, которые позволяют повысить надежность такой ИТ-инфраструктуры по сравнению с физической.

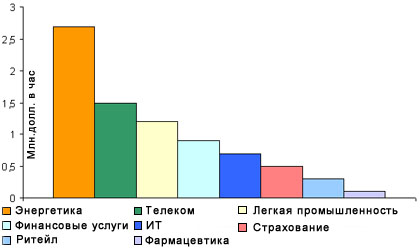

Стоимость простоев ИТ-сервисов по отраслям, 2009

Источник: META Group, 2009

К ним относятся службы высокой доступности, позволяющие перезапустить виртуальные машины отказавшего сервера с общего хранилища, катастрофоустойчивые решения, которые предлагаются как производителями оборудования, так и вендорами платформ виртуализации, а также средства резервирования соединений в сетях передачи и хранения данных. Кроме того, некоторые производители платформ предлагают дополнительные службы, такие как непрерывная доступность виртуальных машин даже в случае отказа физического сервера, и мониторинг доступности гостевых операционных систем, а также управляющего сервера виртуализации.

Поэтому, с точки зрения возможностей восстановления ИТ-инфраструктуры после сбоев, можно сказать, что виртуальная вычислительная среда предприятия, работающая на базе общего хранилища, достаточно надежно защищена от внеплановых простоев. Этот факт подтверждается практикой многочисленных компаний, которые сегодня используют виртуализацию в промышленной среде.

Но непрерывное функционирование ИТ-сервисов – это не только способность возобновить работу приложений в случае отказов компонентов инфраструктуры, но и необходимость быстро восстановить данные в случае их порчи или утери (например, по вине пользователя), что делает необходимым использование решений для резервного копирования в среде с любым уровнем отказоустойчивости.

Здесь технология виртуализации становится опасной: поскольку сразу несколько виртуальных систем размещено на общем хранилище, риск потерять большой объем данных существенно возрастает. При этом возможность утери данных внутри гостевых операционных систем по-прежнему остается серьезной проблемой.

Многие компании используют традиционный подход к резервному копированию даже в виртуальной инфраструктуре, не желая признавать, что "правила игры" у виртуализации меняют подход к данному процессу. Во-первых, виртуальная машина – это всего лишь набор из двух-трех файлов на общем или локальном хранилище, что позволяет, сохранив их, сделать резервную копию всей системы. Во-вторых, большинство платформ виртуализации имеют функцию создания мгновенных снимков состояния виртуальных машин (снапшотов), что дает возможность создать ее резервную копию во время рабочего дня без загрузки гостевой системы, существенно расширив окно резервного копирования. Ну и, наконец, резервное копирование виртуальных машин, ввиду первого и второго факторов, не требует агентов в гостевых операционных системах, а резервирование напрямую в сети хранения данных (SAN-to-SAN Backup) становится значительно более простой процедурой.

Разница в среде

Традиционное резервное копирование физической инфраструктуры подразумевает установку агентов в операционные системы, ориентированных на резервирование отдельных файлов или объектов приложений (например, агенты для БД Oracle или Exchange). Данный подход хорошо работал исторически и позволял восстанавливать отдельные ИТ-сервисы из резервных копий, хранящихся, например, на ленточных носителях. Это позволяло эффективно резервировать отдельные файлы и объекты, но проблемы возникали, когда требовалось восстановление сервиса полностью.

С появлением виртуализации и первых внедрений технологии, многие компании продолжали использовать данный метод для виртуальных систем, рассматривая их с точки зрения резервирования как физические системы. Но такой подход работал неэффективно: внедрение системы резервного копирования стоило достаточно дорого, а восстановление требовало множества операций. Кроме того, обслуживание таких систем обходилось в значительную сумму.

Однако вскоре стало очевидно, что парадигму надо менять: виртуализация "перетянула" большинство систем на СХД, а структура сетей SAN позволила передавать большие объемы данных. Поэтому возможность резервировать виртуальные машины целиком на уровне образов стала главной тенденцией и заставила вендоров продуктов для резервного копирования добавить поддержку технологий виртуализации. Поддержка виртуализации на сегодняшний день есть в корпоративных продуктах для резервного копирования HP Data Protector, Symantec Veritas NetBackup и IBM Tivoli Storage Manager и других.

В виртуальной среде инфраструктура резервного копирования работает следующим образом: создается снимок виртуального диска (снапшот), при этом виртуальная машина продолжает запись данных во временный диск отличий. Система резервного копирования копирует этот диск (незаблокированный виртуальной машиной) и файл ее конфигурации на целевое хранилище, после чего оба диска "сливаются" в исходный. При этом гостевая операционная система не чувствует происходящих операций.

В этих условиях становится важной дедупликация данных резервных копий – эту технологию сейчас предоставляют большинство вендоров систем резервного копирования, и на стоимость этого функционала необходимо обратить особое внимание.

Здесь также нужно отметить технику создания мгновенных снимков на уровне дисковых массивов, которая может с успехом применяться как в физической, так и в виртуальной среде для создания резервных копий большого количества систем. Данный подход имеет множество преимуществ, но его использование стоит значительных средств, кроме того, в этом случае затруднено восстановление отдельных файлов, которое чаще всего оказывается нужным для конкретной системы.

Как виртуализация влияет на требования RTO и RPO?

Безусловно, виртуализация как инновационная технология, расположенная на самом нижнем уровне ИТ-сервисов, не могла не внести изменения в концепцию резервного копирования. Помимо экономического эффекта, повышение непрерывности бизнеса предприятия является, пожалуй, вторым по значимости преимуществом виртуализации.

В системах резервного копирования и восстановления ИТ-инфраструктуры важны такие показатели как RTO (Recovery Time Objective) и RPO (Recovery Point Objective), определяющие требования ко времени и контрольной точке восстановления данных.

Очевидно, что способность восстановления инфраструктуры после сбоев характеризуется этими показателями, а время возобновления работы ИТ-служб в случае сбоя напрямую зависит от объема инвестиций в систему резервного копирования. При этом каждая секунда простоя сервисов – это потерянные деньги для бизнеса. Поэтому одна из основных задач системы резервного копирования – найти разумное соотношение между двумя этими факторами.

Если говорить об RTO – то в общем смысле это то допустимое время, которое может пройти до восстановления работоспособности ИТ-службы. Здесь виртуализация позволяет существенно уменьшить RTO для любого сервиса, поскольку резервное копирование не зависит от операционной системы и приложений в виртуальной машине, и работает только на уровне виртуальных дисков. Соответственно, при сбое восстановление сервиса целиком в виде виртуального диска как одного файла происходит в виртуальной среде максимально быстро. Конечно же, подобные возможности существуют и для физической инфраструктуры (например, в продуктах Symantec), но они имеют существенные ограничения для применения, поскольку сильно зависят от характера резервируемой системы.

Поделиться

Поделиться