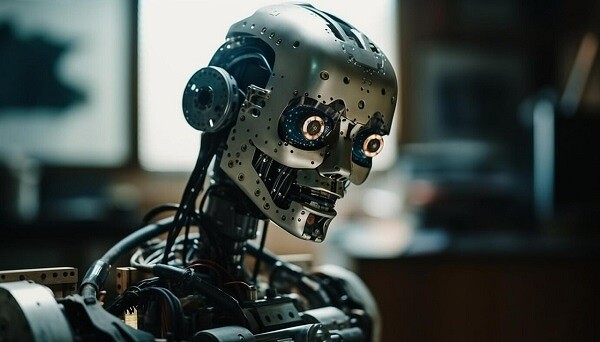

Разработка OpenAI может угрожать человечеству: сотрудники били тревогу в закрытом письме

Стало известно о письме исследователей OpenAI руководству компании, в котором те предупреждают о некоем угрожающем человечеству достижении. Сразу после этого письма в OpenAI начались скандалы, а исполнительного директора уволили - на четыре дня.

Что это мы натворили?

Исследователи компании OpenAI незадолго до скандального увольнения и не менее скандального возвращения исполнительного директора компании Сэма Олтмана (Sam Altman), написали совету директоров письмо, в котором утверждалось, что разработчикам удалось сделать некое устрашающее открытие, которое может угрожать человечеству. Об этом сообщает агентство Reuters.

Информация об этом письме всплыла лишь в среду, на следующий день после того, как Олтман триумфально вернулся в свою компанию после «четырехдневного изгнания».

Более 700 работников OpenAI, в свою очередь, пригрозили перейти в Microsoft, если текущее правление не оставит свои должности в полном составе.

Вот вам Бог, а вот вам двери

Правление компании решило выставить Олтмана за дверь 17 ноября. Основанием стало то, что Олтман, дескать, был «недостаточно честен в своих коммуникациях».

В OpenAI по сути два лидера - Олтман, который служит публичным лицом компании и в значительной степени отвечает за поиск спонсоров и инвесторов, и Илья Суцкевер (Ilya Sutskever), руководящий именно разработками.

По некоторым данным, Олтман считает, что прогресс хорош сам по себе и готов коммерциализировать все, что можно коммерциализировать. Суцкевер же, наоборот, считается сторонником максимально осторожного, консервативного (в позитивном смысле) подхода, когда любой коммерциализации разработки должно предшествовать глубокое изучение возможных последствий.

По данным источников Reuters, конфликт внутри компании зрел давно, и его пиком стало краткосрочное увольнение Олтмана, причем Суцкевер играл в этом значительную роль. Впрочем, он вскоре заявил, что весьма сожалеет о своих действиях и действиях совета директоров. После того, как Олтман вернулся, стало известно о самороспуске и переучреждении совета директоров OpenAI.

Что было в письме

В материале Reuters утверждается, что копию письма правлению от исследователей журналистам получить не удалось, а его предполагаемые авторы на запрос комментария решили не отвечать.

В пресс-службе OpenAI также предпочли отказаться от комментариев. Правда, потом сотрудникам компании было разослано внутреннее письмо, где руководство компании признало существование некоего проекта Q* (или Q-Star).

Некоторые сотрудники OpenAI полагают, что речь идет о проекте общего искусственного интеллекта (artificial general intelligence - AGI).

Обычно под таким интеллектом понимается машина, способная понимать окружающую среду и мир в целом, так же как человек, и обладающая таким же потенциалом, чтобы научиться выполнять самый широкий спектр различных задач.

OpenAI определяет AGI как автономную систему, которая превосходит человека в выполнении большинства экономически значимых задач.

Они действительно сделали это?

Один из источников Reuters из числа сотрудников OpenAI, говоривший на условиях анонимности, новая модель смогла решить определенные «математические проблемы». И хотя машина производила собственно математические вычисления на уровне «учеников начальной школы», однако успешное выполнение и таких тестов вселило в исследователей большой оптимизм в отношении будущего успеха Q*.

«По-видимому, речь шла не только об оптимизме: если изначальное письмо действительно было настолько алармистским, что привело к смене руководства компании, то опасения, вероятно, были чем-то оправданы», - полагает технический директор компании SEQ Алексей Водясов. Он считает, что в любом случае необходимо соблюдать предельную осторожность вне зависимости от того, удалось ли OpenAI реализовать полноценный AGI или речь идет только о каком-то шаге в этом направлении.

Математика - царица всех наук

Исследователи считают математику основным фронтиром генеративных ИИ. На сегодняшний день разработки вроде ChatGPT хорошо справляются с созданием и переводом текстов, статистически предсказывая следующее слово. Как следствие, ответы могут заметно различаться.

Однако что касается математики - где только один ответ на ту или иную задачу будет верным, - тут ИИ приходится демонстрировать способность к расширенному рассуждению по аналогии с человеческим разумом. А в отличие от калькулятора, ИИ должен уметь обобщать, учиться и понимать.

То, что с задачами новый ИИ справился хотя бы на уровне младшеклассника, означает, что открылись новые перспективы. Но исследователи видят в этом и угрозу - ту самую, которая нередко описывается в фантастике: машины приходят к выводу, что люди им больше не нужны и что уничтожение человечества - в их интересах.

В своем письме эксперты также отметили потенциальную угрозу от проекта «ИИ-ученый» внутри OpenAI. Ее существование подтвердили сразу несколько источников. Группа исследовала возможности оптимизировать существующие ИИ-модели, научить их рассуждению и в итоге осуществлять полноценные научные исследования.

Поделиться

Поделиться